|

史上最快大模型炸场!Groq一夜爆红,自研LPU速度碾压英伟达GPU 英伟达的挑战者Groq登场!抛弃GPU,自研LPU!文本生成速度比眨眼还快!推理场景速度比英伟达GPU快10倍,但价格和耗电量都仅为后者十分之一。 一觉醒来,AI圈又变天了。 还没消化完Sora带来的震撼,又一家硅谷初创企业带着史上最快的大模型和自研芯片LPU霸占了热搜。 就在昨天,AI芯片创企Groq(不是马斯克的Gork)开放了自家产品的免费试用。相比其他AI聊天机器人,Groq闪电般的响应速度迅速引爆互联网讨论。经过网友测试,Groq每秒生成速度接近500 tok/s,碾压GPT-4的40 tok/s。 有网友震惊地说:

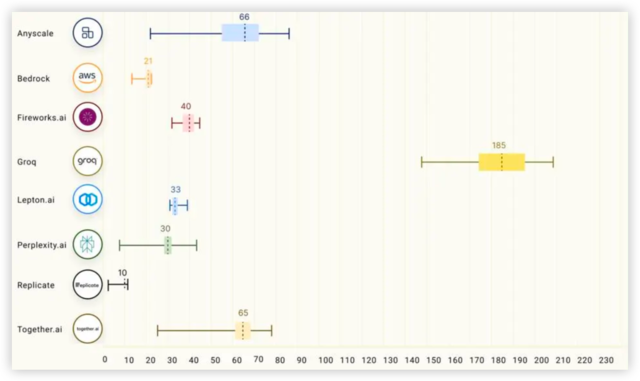

不过,需要强调的是,Groq并没有研发新模型,它只是一个模型启动器,主页上运行的是开源模型Mixtral 8x7B-32k和Llama 270B-4k。 冠绝大模型圈子的响应速度,来自驱动模型的硬件——Groq并未使用英伟达的GPU,而是自研了新型AI芯片——LPU(Language Processing Units)。 每秒500 tokens,写论文比你眨眼还快 LPU最突出的特点就是快。 根据2024年一月的测试结果,由Groq LPU驱动Meta Llama 2模型,推理性能遥遥领先,是顶级云计算供应商的18倍。  图片来源:GIT HUB 图片来源:GIT HUB

华尔街见闻此前文章提及,Groq LPU搭配Meta Llama 2 70B能在7分钟内就能生成与莎士比亚《哈姆雷特》相同数量的单词,比普通人的打字速度快75倍。 如下图所示,有推特网友问了一个和营销有关的专业问题,Groq在四秒钟之内就输出了上千词的长篇大论。

还有网友测试同时用Gemini、GPT-4和Groq完成一个代码调试问题。 结果,Groq的输出速度比Gemini快10倍,比GPT-4快18倍。 Groq在速度上对其他AI模型的降维打击,让网友直呼,“AI推理界的美国队长来了”。

LPU,英伟达GPU的挑战者? 再强调一遍,Groq没有开发新的模型,它只是用了不一样的芯片。 根据Groq官网的介绍,LPU是一种专为AI推理所设计的芯片。驱动包括GPT等主流大模型的GPU,是一种为图形渲染而设计的并行处理器,有数百个内核,而LPU架构则与GPU使用的SIMD(单指令,多数据)不同,这种设计可以让芯片更有效地利用每个时钟周期,确保一致的延迟和吞吐量,也降低了复杂调度硬件的需求:

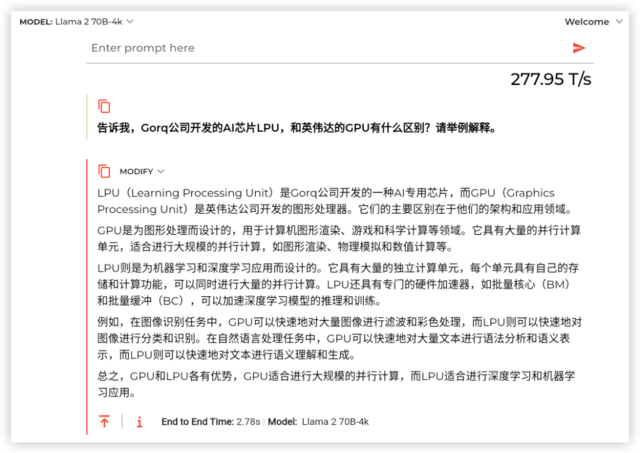

简单来说,对用户而言,最直观的体验就是“快”。 使用过GPT的读者一定知道,痛苦地等待大模型一个一个地吐出字符是一种怎样痛苦的体验,而LPU驱动下的大模型,基本可以做到实时响应。 比如下图,华尔街见闻向Groq询问LPU和GPU的区别,Groq生成这个回答用时不到3秒,完全不会像GPT、Gemini那样出现显著的延迟。如果以英文提问,生成速度还会更快。

Groq官方的介绍还显示,创新的芯片架构可以把多个张量流处理器(Tensor Streaming Processor,简称TSP)连接在一起,而不会出现GPU集群中的传统瓶颈,因此具有极高的可扩展性,简化了大规模AI模型的硬件要求。 能效也是LPU的另一个亮点。通过减少管理多个线程的开销和避免内核的利用率不足,LPU每瓦特可以提供更多的算力。 Groq创始人兼首席执行官Jonathan Ross在采访中,时时不忘给英伟达上眼药。 他此前对媒体表示,在大模型推理场景,Groq LPU芯片的速度比英伟达GPU快10倍,但价格和耗电量都仅为后者的十分之一。 实时推理是通过经过训练的AI模型运行数据的计算过程,以提供AI应用的即时结果,从而实现流畅的最终用户体验。随着AI大模型的发展,实时推理的需求激增。 Ross认为,对于在产品中使用人工智能的公司来说,推理成本正在成为一个问题,因为随着使用这些产品的客户数量增加,运行模型的成本也在迅速增加。与英伟达GPU相比,Groq LPU集群将为大模型推理提供更高的吞吐量、更低的延迟和更低的成本。 他还强调,Groq的芯片,由于技术路径不同,在供应方面比英伟达更充足,不会被台积电或者SK海力士等供应商卡脖子:

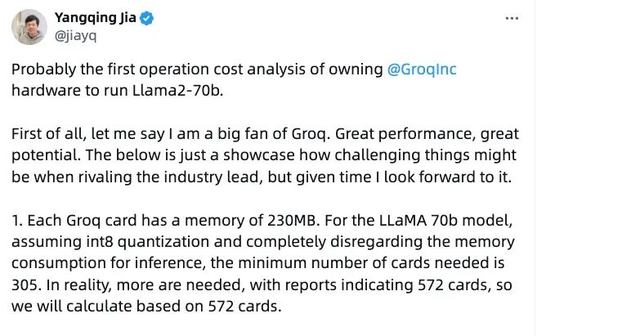

不过,另有一些AI专家在社交媒体上表示,Groq芯片的实际成本并不低。 如人工智能专家贾扬清分析称,Groq综合成本相当于英伟达GPU的30多倍。 考虑到每张Groq芯片的内存容量为230MB,实际运行模型需要572张芯片,总成本高达1144万美元。 相比之下,8张H100的系统在性能上与Groq系统相当,但硬件成本仅为30万美元,年度电费约2.4万美元。三年总运营成本对比显示,Groq系统的运营成本远高于H100系统,

而且,更关键的是,LPU目前仅用于推理,要训练大模型,仍然需要购买英伟达GPU。 创始人为谷歌TPU设计者之一 相信未来2年能卖出100万个LPU 在今天互联网上一炮而红之前,Groq已经低调埋头研发7年多的时间。 公开资料显示,Groq成立于2016年,总部位于美国加州圣塔克拉拉山景城。公司创始人Jonathan Ross是前谷歌高级工程师,是谷歌自研AI芯片TPU的设计者之一。产品主管John Barrus曾在谷歌及亚马逊担任产品高管。

高管内唯一一位华裔面孔、副总裁Estelle Hong,在公司任职已有四年,此前曾供职于美国军队及英特尔。 就在去年8月,Groq也宣布了和三星的合作计划,表示其下一代芯片将在美国德克萨斯州三星芯片工厂采用4纳米工艺生产,预计量产时间为24年下半年。 展望下一代LPU,Ross相信GroqChip的能效将提高15到20倍,可以在相同的功率范围内为设备增加更多的矩阵计算和SRAM存储器。 在去年底的采访中,Ross表示,考虑到GPU的短缺和高昂的成本,他相信Groq未来的发展潜力:

责任编辑:郭明煜 |